-

学生基于深度知识追踪的学习与遗忘

普通类 -

- 支持

- 批判

- 提问

- 解释

- 补充

- 删除

-

-

更改题目:《基于深度学习的知识追踪模型》

-

写作框架

-

摘要

构建精准的学习者模型,是教育者实现个性化指导、学习者实现个性化学习的前提。知识追踪可以对学习者知识掌握状态进行动态估计和预测,是建立学习者模型的核心技术。文章聚焦于基于深度学习的知识追踪模型,首先介绍了知识追踪模型的基本含义,简要概述了目前深度知识追踪模型的研究进展。随后,文章详细阐述了基于记忆网络的知识追踪模型,基于注意力机制的知识追踪模型、基于卷积神经网络的知识追踪模型和基于图神经网络的知识追踪模型的基本原理和模型应用情况。最后,文章总结和分析了基于深度学习的知识追踪模型应用的现状,并针对深度学习的知识追踪模型的未来发展提出建设性意见,给予该领域的理论和实践提供参考和帮助。

-

关键词

学习者模型;深度知识追踪;深度学习;教育应用

-

引言

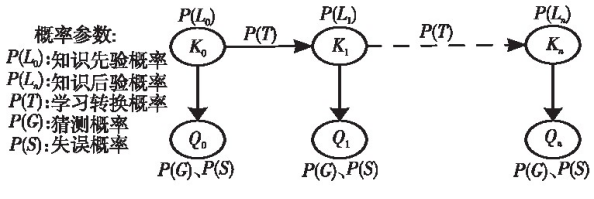

知识追踪模型是模拟学习者知识掌握情况的一个典型模型,由Atkinson于1972年首次提出[1]。知识追踪即通过跟踪学习者的历史学习轨迹,对学习者与学习资源的学习交互过程进行建模,深入分析、挖掘、追踪学习者的动态知识掌握水平与认知结构,并准确预测学习者未来的学习表现[2],其基本含义如图1所示。随着人工智能技术的快速发展,斯坦福大学团队于2015年首次将深度学习引入知识追踪领域,提出深度知识追踪(Deep Knowledge Tracing,DKT)模型[3]。DKT模型主要采用循环神经网络(Recurrent Neural Network,RNN),对学习者的知识状态进行长周期时间维度上的连续表征,并利用其作答序列的时序关系信息进行题目作答对错的预测。DKT模型通过其特有的神经网络结构,选择性遗忘一部分旧作答信息并同时记忆一部分新作答信息,从而可以在多知识点上进行知识追踪[4]。当前,基于深度学习的知识追踪模型主要包含四类深度学习方法(记忆增强网络、注意力网络、卷积神经网络和图神经网络),本研究对这四类深度学习的知识追踪模型的原理分别进行阐述,梳理其技术演进与发展趋势,通过对现有的深度学习知识追踪模型的原理、应用现状、存在的问题及发展趋势进行讨论,为后续的理论和实践研究提供参考。

图1 知识追踪模型的基本含义

-

一、知识追踪概述

知识追踪是教育数据挖掘领域的一个重要研究方向,其目标是通过建立学生知识状态随时间变化的模型,来判断学生对知识的掌握程度,并从学生的学习轨迹中挖掘出潜在的学习规律,从而提供个性化的指导,达到人工智能辅助教育的目的。简单来说就是让我们用一些算法来对在线教育平台中学生的学习状态进行追踪模拟,达到传统的线下教育中因材施教的效果。目前主流的研究方法有:基于贝叶斯的知识追踪(Bayesian knowledge tracing,BKT)和基于深度学习的知识追踪(Deep knowledge tracing,DKT)。

1.基于贝叶斯的知识追踪(BKT)

贝叶斯知识追踪(BKT)是以往最常用的知识追踪模型。在BKT模型中提出了一个关于学生知识状态的隐变量,学生的知识状态由一个二元组表示 {掌握该知识点,没掌握该知识点}。整个模型结构实际上是一个含有隐变量的马尔可夫模型(HMM),通过对学生知识点的一个变化进行追踪,并根据状态转移矩阵来预测学生的下一个知识点掌握情况,以此来预测学生的答题结果。如图2所示的BKT知识追踪模型,图中主要阐释了4个主要参数,L0,T,G,S。而BKT模型的主要任务是根据学生以往的历史答题系列情况学习出这4个对应的参数。其次,BKT是对不同的的知识点进行建模的,理论上来说,训练数据有多少个知识点,就有多少组对应的(L0,T,G,S)参数。

• L0:表示学生未开始做这道题目时,他的一个知识掌握程度如何(即掌握这个知识点的概率是多少),这个我们通常可以从训练数据里面求平均值获得,也可以使用经验,比如一般来说掌握的程度是对半概率,那么L0=0.5。

• T :表示学生经过做题练习后,知识点从不会到学会的概率。

• G:表示学生没掌握这项知识点,但是还是蒙对的概率。

• S:表示学生实际上掌握了这项知识点,但是还是给做错了的概率。

图2 贝叶斯知识追踪模型

2. 深度知识追踪(DKT)

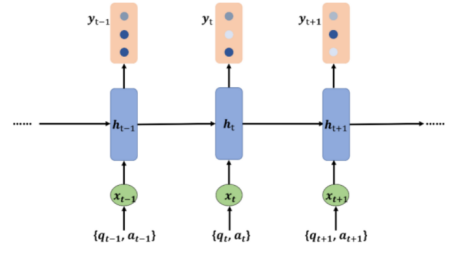

2015年,基于循环神经网络(Recurrent Neural Network,RNN)的深度知识追踪模型被首次提出,DKT采用RNN和LSTM来对学生的学习过程进行时间序列建模,其输入是学生的练习交互数据(习题和答案),用隐藏层来表示学生对所有知识点的掌握情况,并预测学生能够正确回答下一道习题的概率。如图3所示,DKT将试题所涵盖的知识点one-hot向量与学习者的答题结果输入到循环神经网络中,循环神经网络学习学习者的答题序列信息,DKT将循环神经网络的隐向量作为学习者当前知识点的掌握程度,根据当前时刻学习者的知识掌握程度预测学习者未来的答题情况。

基于RNN的DKT模型如图2所示,其基本原理是:首先,将学习者当前的作答信息xt={qt,at}以独热编码或其它编码形式输入到RNN中。其中,qt代表t时刻学习者所做的题目信息,at代表学习者的作答情况信息。其后,RNN利用t-1时刻的内部状态信息ht-1,计算当前t时刻的内部状态信息ht。最后,模型输出层依据内部状态信息ht,计算并输出学习者答对当前题目的概率yt。

图3 基于RNN的DKT模型示意图

DKT深度知识追踪模型探索了RNN网络以及其变体LSTM在知识追踪领域的使用,将学生的历史交互数据作为输入,使用RNN的隐藏状态向量来表示学生的知识水平,并基于此来预测学生的学习表现,打破了BKT不能使各习题、各概念之间产生联系的窘境。但是DKT也存在一些局限性,比如DKT将循环神经网络隐向量作为学习者知识掌握程度的嵌入表示,仅可以建模学习者整体的知识掌握程度,而无法具体建模学习者对于各个知识点的掌握程度;DKT无法建模学习者的遗忘行为,默认学习间隔时间内,学习者对知识的掌握程度没有任何变化;DKT将试题所涵盖的知识点作为试题的嵌入向量,然而现实生活中考察相同知识点的题目由于题目个性不同,难度也不尽相同,DKT完全忽略试题的个性化特征存在一定的局限性。为了解决以上存在的问题,研究者们又陆续将记忆网络、注意力机制、卷积神经网络和图神经网络等其它网络结构,引入知识追踪领域进行建模,以此来构建更为精准的学习者模型,为学习资源精准推荐、个性化学习路径生成、学习预警等个性化教育服务提供基础性保障。

-

二、基于记忆网络的知识追踪模型

1、模型概述

DKT模型可以较好地预测学生题目作答的情况,但DKT模型将循环神经网络隐向量作为学习者知识掌握程度的嵌入表示,仅可以建模学习者整体的知识掌握程度,而无法具体建模学习者对于各个知识点的掌握程度,这使得确定一个学生擅长或不熟悉哪些知识概念非常困难。因此,Zhang等[5]采用记忆增强网络(Memory Augmented Neural Network,MANN)构建了动态键值对记忆网络(Dynamic Key Value Memory Netorks,DKVMN)模型。DKVMN 模型用两个矩阵分别存放知识点信息和知识掌握状态信息,通过特定读取与写入机制,可以直接估计知识掌握状态及其随时间的变化情况。

DKVMN模型借鉴了BKT可以逐个表示学习者对于各个知识点掌握程度以及DKT使用深度学习方法算法提升的优点,利用记忆网络对循环神经网络中的隐层向量进行扩充,增大了记忆容量。

尽管深度知识追踪模型的预测准确性与传统方法相比有很大提升,但它仍存在长序列依赖问题和缺乏可解释的问题。因此许多研究者在深度知识追踪的框架上提出了优化模型。其中比较经典的是基于记忆增强神经网络(Memory Augmented Neural Network,MANN)的动态键值记忆网络模型(Dynamic Key-Value Memory Networks for Knowledge Tracing)。

记忆增强神经网络解决了以往深度知识追踪记忆容量太小的缺点,其主要通过添加设计好的存储模块,将与结果有关的信息存入状态向量中,并对这些向量做读写操作以更新记忆,这种网络允许保留多个隐藏状态变量,大大扩充了模型的记忆容量。简要来说,记忆增强神经网络是指内存给模型提供了一个短期记忆功能,模型可以“记住”刚刚给它传递的信息。比如对于可以阅读理解和交互的模型来说,当它读完一篇文章,它所理解的信息还包含在内存中,你问它关于这篇文章的问题时,它就能读取内存中存储的文章抽象作答,这就是MANN。记忆增强神经网络的结构如下:

图4 记忆增强神经网络的结构

如上图所示,记忆增强神经网络主要有四个组成部分,分别为控制器、外部记忆模块、读出模块以及写入模块。控制器是模型的核心,目标是控制外部与内容之间的交互。外部记忆单元由许多记忆片段按照一定的规则堆积构成,用来存入信息,读出模块用于从外部记忆模块中获取相应的内容,写入模块用于更新外部记忆。

2、模型框架

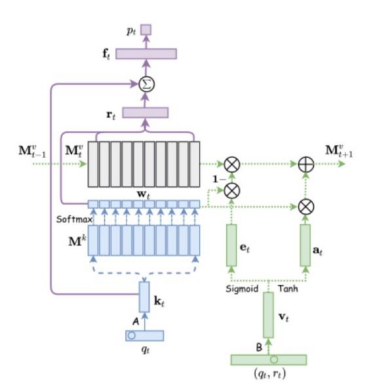

动态键值记忆网络是记忆增强神经网络的一种,起先被用于机器翻译,后被引入知识追踪领域。动态键值记忆网络通过一个额外的记忆矩阵存储学习者所学习到的知识,矩阵中每一个向量都代表了学习者对一个知识点的掌握水平,这个记忆矩阵的维度很大,因此DKVMN模型具有较大的记忆容量。DKVMN模型中假设每个习题都代表一个隐含知识点,每一个记忆向量中存储着学习者对下一个隐含知识点的掌握水平。这使得模型能更新学习者对一个知识点的掌握状况,并且同时保持无关知识点不变。DKVMN模型的结构如下:

图5 DKVMN模型的结构图

该模型主要由三部分组成,蓝色部分表示计算学生作答题目与知识点之间的权重,紫色部分表示读取学生对相关知识点的掌握情况并进行预测,绿色部分表示更新学生的知识掌握情况。另外,DKVMN使用两个矩阵表示记忆区域,其中,Mk表示静态记忆矩阵,它存储着当前的所有知识点信息,Mv表示动态记忆矩阵,它存储着学习者对每个知识点的掌握状况,并根据添加向量at和删除向量et来不断更新学习者对于知识点的掌握情况。

DKVMN不但实现了很高的预测精度,还具有一些附加的优秀性能,比如它能够输出学生对知识点的熟练程度和模拟练习题与知识点状态之间的转换,是近几年来知识追踪领域的研究热点。

-

三、基于注意力机制的知识追踪模型

1、模型概述

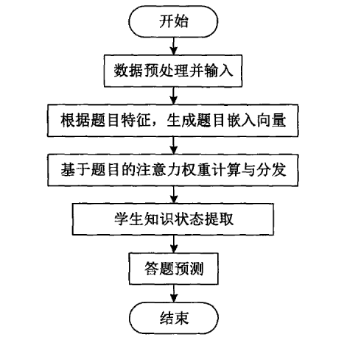

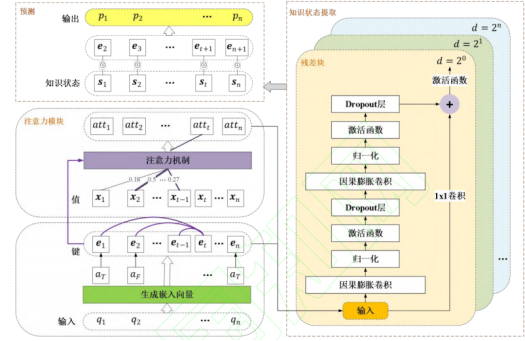

我们人类的大脑在处理外部信息时,会自动对信息进行筛选,从错综繁杂的信息中提取有用的信息,而忽略另一部分无用的信息。而对于深度学习的知识追踪模型来说,大量的数据有利于增强神经网络的表达和学习能力,但是随着数据的不断增加,模型中所包含的信息量也会越来越大,使得模型难以区分对训练任务最有帮助的信息。而神经网络通过借助人脑的注意力能力,引入了注意力机制(Attention Mechanism),以此来解决深度知识追踪模型存在的可解释性不足和长序列依赖问题。注意力机制主要是指在神经网络处理某个任务时,只关注与该任务最相关的一部分数据,而忽略其它数据,一定程度上提高了模型的可解释性。并基于深度知识追踪模型的局限性提出一种融合注意力机制的时间卷积知识追踪模型(Temporal Convolutional Knowledge Tracing with Attention mechanism,ATCKT)。ATCKT模型主要的贡献如下:(1)提出一种多特征融合的题目生成方式,生成包含题目-知识点关系和题目难度的题目嵌入向量,丰富了题目特征;(2)通过基于题目的注意力机制,识别并强化学生的历史相关表现,丰富学生特征,提高了预测过程的可解释性;(3)使用时间卷积网络结构提取学生的知识状态,缓解长序列依赖问题。

首先学习学生历史交互的嵌入表示,然后使用基于题目的注意力机制学习特定权重矩阵,识别并强化学生的历史交互对每一时刻知识状态不同程度的影响;最后,使用时间卷积网络(TCN)提取学生动态变化的知识状态,利用扩张卷积和深层神经网络扩大序列学习范围,缓解长序列依赖问题。

2、模型框架

ATCKT模型的流程图如图6所示,主要包括四个步骤:(1)从学生的交互数据中提取题目涉及的知识点和题目的难度特征,经过嵌入层对题目进行嵌入编码,生成包含丰富语义信息的题目嵌入;(2)考虑到学生对不同知识点的掌握程度不同,使用基于题目的注意力机制,根据题目之间的相似性,为历史交互分配不同的注意力权重,得到学生的历史相关表现;(3)使用时间卷积网络建模学生的学习过程,提取学生动态变化的知识状态;(4)通过学生的知识状态,预测学生下一时刻的答题表现。

图6 ATCKT模型流程图

ATCKT模型框架如图7所示。该模型主要由四个部分组成,分别是题目嵌入模块、注意力模块、知识状态提取模块和答题预测模块。具体地,题目嵌入模块主要用来生成题目嵌入向量。首先,通过嵌入层使用映射表将题目对应的知识点映射为嵌入向量,然后将题目难度特征映射为等长的向量,将二者以不同比例拼接,作为题目嵌入表示。学生的历史记录可以表示为题目嵌入与答题结果的拼接。

注意力模块主要用来计算学生的历史相关表现。学生的答题表现直接反映了学生对题目的掌握情况,学生过去对相似题目做出的答题结果,可以在很大程度上反映学生未来答对相关题目的概率。因此本文使用基于题目的注意力机制,建模当前作答题目与历史作答题目的关联,对学生过去的答题记录进行注意力权重分配,增强模型的可解释性。

在知识状态提取模块,将学生交互记录和历史相关表现作为输入,使用时间卷积网络提取学生每个时刻的知识状态。时间卷积网络借助因果卷积保证未来的信息不会发生泄漏,可以很好地处理知识追踪这种时序建模问题。使用了扩张卷积和更深层的神经网络,可以考虑到学生很长时间之前的交互对当前时刻的影响,缓解长序列依赖问题。

在答题预测模块,将学生的知识状态与下一时刻要作答的题目嵌入进行点积运算,经过sigmoid函数得到一个0~1之间的值,表示学生正确回答下一时刻题目的概率。

图7 ATCKT模型结构图

-

四、基于卷积神经网络的知识追踪模型

1、模型概述

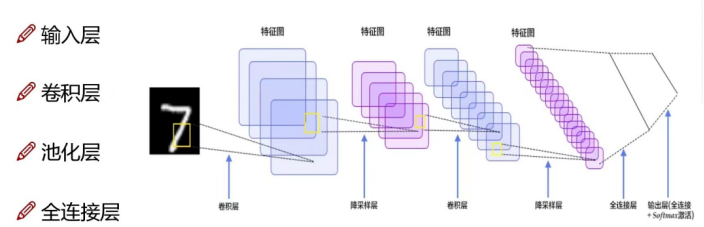

卷积神经网络是一种带有卷积结构的深度神经网络,卷积结构可以减少深层网络占用的内存量,其核心模块是多层的监督学习神经网络,可以实现卷积神经网络特征提取功能。

Shen等[9]认为DKT和DKVMN模型都忽略了个体学习者在先验知识、学习能力上的区别,因此利用卷积神经网络(Convolutional Neural Network,CNN)构建了卷积知识追踪(Convolutional Knowledge Tracing,CKT)模型。该模型专门设计了卷积层,可以在滑动窗口的同时处理多个连续作答记录,以提取学习者的能力特征。

卷积神经网络结构总共有四个部分:输入层、卷积层、池化层、全连接层。如图8所示,其中每一层都有多个特征图,每个特征图通过一种卷积滤波器提取输入的一种特征,而每个特征图又有多个神经元。输入图像统计和滤波器进行卷积之后,提取该局部特征,一旦该局部特征被提取出来之后,它与其他特征的位置关系也随之确定下来了,每个神经元的输入和前一层的局部感受野相连,每个特征提取层都紧跟一个用来求局部平均与二次提取的计算层,也叫特征映射层,网络的每个计算层由多个特征映射平面组成,平面上所有的神经元的权重相等。

(1) 输入层: 如图中的最左边的图片就是我们输入层需要输入的,又因为图片输入是以RGB三通道的形式输入,所以d通常是3,如下图中的第二张图片就是后面三个通道图片相叠加而来。

(2) 卷积层: 我们可以将卷积层的核心看作一个矩阵形式的运算器,卷积神经网络中每层卷积层由若干卷积单元组成,每个卷积单元的参数都是通过反向传播算法最佳化得到的。卷积运算的目的是提取输入的不同特征,第一层卷积层可能只能提取一些低级的特征如边缘、线条和角等层级,更多层的网路能从低级特征中迭代提取更复杂的特征。

(3) 池化层: 池化(Pooling)是卷积神经网络中另一个重要的概念,它实际上是一种形式的降采样。有多种不同形式的非线性池化函数,而其中“最大池化(Max pooling)”是最为常见的。它是将输入的图像划分为若干个矩形区域,对每个子区域输出最大值。直觉上,这种机制能够有效地原因在于,在发现一个特征之后,它的精确位置远不及它和其他特征的相对位置的关系重要。池化层会不断地减小数据的空间大小,因此参数的数量和计算量也会下降,这在一定程度上也控制了过拟合。

(4) 全连接层: 全连接层在整个卷积神经网络中起到”分类器”的作用。如果说卷积层和池化层这两个操作是将原始数据映射到隐层特征空间的话,全连接层则起到将学到的”分布式特征表示”映射到样本标记空间的作用。

图8 CNN的整体架构

2、模型框架

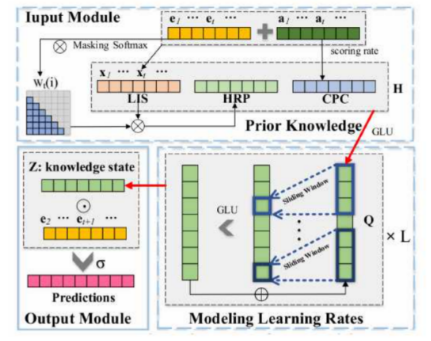

Shen 等人[9]认为大多数知识追踪模型没有对学生进行个性化建模,他们认为学生在做题时的先验知识和学习率是因人而异的。据此他们提出了基于卷积神经网络的 CKT 模型(Convolutional Knowledge Tracing),其结构如图9所示。

图9 基于卷积神经网络的模型(CKT)

CKT 由三个模块组成:输入模块,学习率模块,输出模块。输入模块包含学习交互序列(LIS),历史相关表现(HRP)和知识点正确率(CPC)三部分,LIS 由历史交互行为向量组成。Shen 等[9]人认为学生的先验知识隐含在历史答题记录中,学生在相同习题上可能得到相同的分数,且得分率可以看作是学生总体知识掌握水平的反馈。因此模型综合学生的历史学习记录,从历史相关表现(HRP)和知识点正确率(CPC)两方面捕捉不同学生的先验知识。随后,学习率模块通过堆叠 L 层一维卷积神经网络,从输入模块的结果矩阵中提取学生的学习率特征,并在卷积过程中加入滑动窗口限制输入信息,避免包含未来的答题记录。最后通过将学生知识状态和下一习题的嵌入向量做点积,预测学生能否做对下一道题。

-

五、结论展望

本研究简要梳理了当前知识追踪模型的研究进展,详细阐述了三类基于深度学习的知识追踪模型的模型概述和模型框架。根据知识追踪的发展进程,每一类知识追踪模型均在原始模型的基础上逐步增加了影响认知过程的多种关键因素,让其能够更加适用于教育场景。当前,基于深度学习的知识追踪模型正在被各界关注,具有良好的发展前景。为了准确诊断学习者的知识掌握状态来预测其未来的表现,各国研究者正积极构建新的知识追踪模型或改进已有的模型,来让这些模型更好地应用于我们的教育场景中。但不可否认的是,当前知识追踪模型的研究仍然具有一定的局限性,如模型的准确率与通用性有待提高、模型算法与内部结构日趋复杂等。

为了更好地推动该领域的深入研究,本研究提出以下两点建议:①由于人的知识记忆与理解过程的复杂性较高,因此研究者们可借鉴脑科学中的理论与方法对知识追踪模型进一步改善。②人工智能领域涉及很多深度神经网络,因此建模的时候很多学习的数据并不易采集,且所建模型的可解释性都较差,本文建议后续研究可以利用小规模数据构建透明且可信的知识追踪模型。

-

参考文献

[1] 李菲茗,叶艳伟,李晓菲,史丹丹. 知识追踪模型在教育领域的应用:2008—2017年相关研究的综述[J]. 中国远程教育,2019,(07):86-91.

[2] 王志锋,熊莎莎,左明章,闵秋莎,叶俊民. 智慧教育视域下的知识追踪:现状、框架及趋势[J]. 远程教育杂志,2021,39(05):45-54.

[3] Piech C, Spencer J, Huang J, et al. Deep knowledge tracing[A]. Annual Conference on Neural Information Processing Systems[C]. New York City: Curran Associates Inc, 2015:505-513.

[4] 卢宇,王德亮,章志,陈鹏鹤,余胜泉. 智能导学系统中的知识追踪建模综述[J]. 现代教育技术,2021,31(11):87-95.

[5]Zhang J, Shi X, King I, et al. Dynamic key-value memory networks for knowledge tracing[C]//Proceedings of the 26th international conference on World Wide Web. 2017: 765-774.

[6]Pandey S, Karypis G. A self-attentive model for knowledge tracing[J]. arXiv preprint arXiv:1907.06837, 2019.

[7]Ghosh A, Heffernan N, Lan A S. Context-aware attentive knowledge tracing[C]//Proceedings of the 26th ACM SIGKDD international conference on knowledge discovery & data mining. 2020: 2330-2339.

[8]hen S, Liu Q, Chen E, et al. Convolutional knowledge tracing: Modeling individualization in student learning process[C]//Proceedings of the 43rd International ACM SIGIR Conference on Research and Development in Information Retrieval. 2020: 1857-1860.

[9]Nakagawa H, Iwasawa Y, Matsuo Y. Graph-based knowledge tracing: Modeling student proficiency using graph neural net[C]//Proceedings of the international conference on learning representations (ICLR). 2019: 1-8.

[10] 刘恒宇,张天成,武培文,于戈. 知识追踪综述[J]. 华东师范大学学报(自然科学版),2019,(05):1-15.

[11] 邵小萌,张猛. 融合注意力机制的时间卷积知识追踪模型[J]. 计算机应用:1-7.

[12] 王梦旦. 基于图嵌入和注意力的知识追踪模型研究[D].华东师范大学,2022.

-

-

- 标签:

-

加入的知识群:

学习元评论 (0条)

聪明如你,不妨在这 发表你的看法与心得 ~